Google DeepMind於6月24日正式發布全新語言模型「Gemini Robotics On-Device」,標誌著AI與機器人融合發展進入新階段。該模型最大特色為可於機器人本地端獨立運行,無需依賴雲端連接,即可實現即時控制與任務執行,提升自主性、反應速度與資料安全性。

相較以往AI機器人仰賴雲端推理處理複雜指令,Gemini Robotics On-Device可直接在機器人裝置內運行視覺、語言與動作整合模型(VLA),全面處理影像輸入、自然語言理解與動作生成等核心任務。Google表示,該模型是今年3月發表的雲端版Gemini Robotics的延伸版本,在準確性與即時反應性方面已非常接近雲端水準,並在多項測試中優於其他現有本地模型。

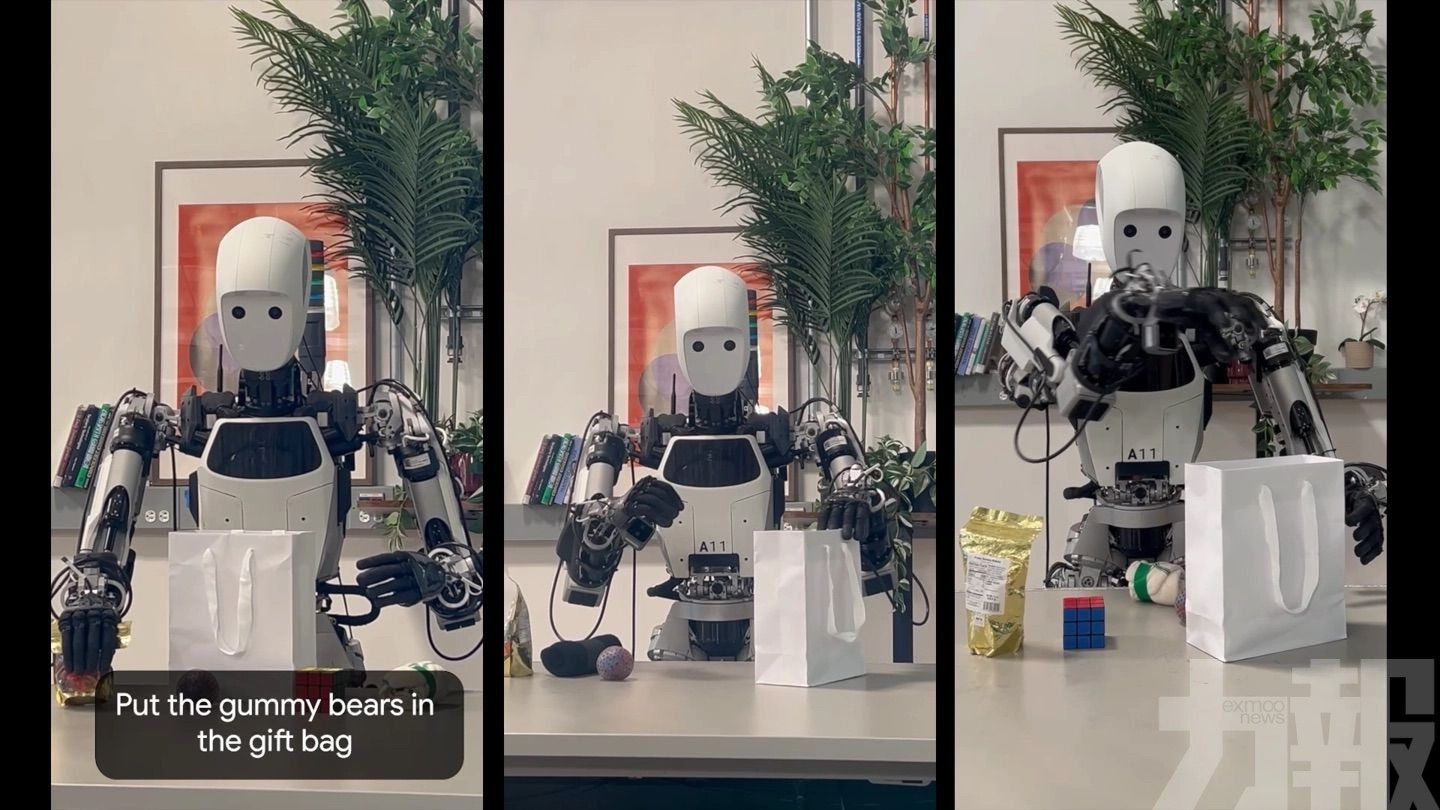

根據官方展示,搭載該模型的機器人可順利完成如拉開背包拉鍊、摺疊衣物、整理物品等日常任務。儘管該模型最初為ALOHA機器人所設計,經優化後也成功應用於雙臂機器人Franka FR3與韓國Apptronik開發的人形機器人Apollo。值得一提的是,Franka FR3甚至能應對從未訓練過的新場景與物件,在工業輸送帶上完成組裝任務,展現出強大泛化能力。

示範100次可學會新動作

DeepMind機器人技術主管Carolina Parada指出,這項突破來自Gemini模型本身強大的多模態理解與生成能力。「正如Gemini能寫詩、寫程式,它也能產生合適的機器人動作。」她強調,這使得機器人不再侷限於反覆強化學習的固定場景,而是具備理解並執行新指令的能力。

為協助開發者加速應用部署,Google同步推出Gemini Robotics SDK,內建MuJoCo物理模擬器,開發者僅需50至100次示範操作,即可訓練機器人學習新任務,並在虛擬環境中進行測試。該模型也是Google首次釋出的可開發、可微調的本地端VLA模型,允許依照具體任務需求進行客製化調整。

Google強調,與傳統依賴雲端的架構相比,On-Device模型能在無網絡環境下持續運作,特別適用於偏遠地區、網絡不穩定場所,或如醫療、家庭等對隱私與連續性要求極高的應用場景。本地運行不僅保障即時反應,也提升數據安全性與可靠性。

然而,針對生成式AI應用於實體機器的潛在風險,Google亦未忽視安全議題。Parada坦言,AI輸出具一定隨機性,在聊天機器人中無傷大雅,但應用於機器人則可能引發安全問題。為此,Google建議開發者採取多層次安全策略,包括接入Gemini Live API進行語義審查、設置硬體動作邊界控制器,以及參與語義紅隊演練(Red-Teaming)來預防潛在風險。

目前,Google已啟動「受信任測試者計畫」,邀請全球開發者參與模型及SDK測試。Google表示,該模型基於Gemini 2.0構建,未來將跟隨Gemini 2.5等進階版本持續更新機器人系統性能。

在AI與機器人結合持續升溫的背景下,Google此舉被視為業界關鍵進展。除了Google外,輝達(NVIDIA)正積極打造人形機器人專用基礎模型平台,Hugging Face則開發開源語言模型並涉足機器人領域;來自南韓、獲得未來資產支持的新創RLWRLD,也正研發專用AI基礎模型。隨著各方勢力布局加速,AI機器人賽道正迅速從概念走向實用。 (編輯部)