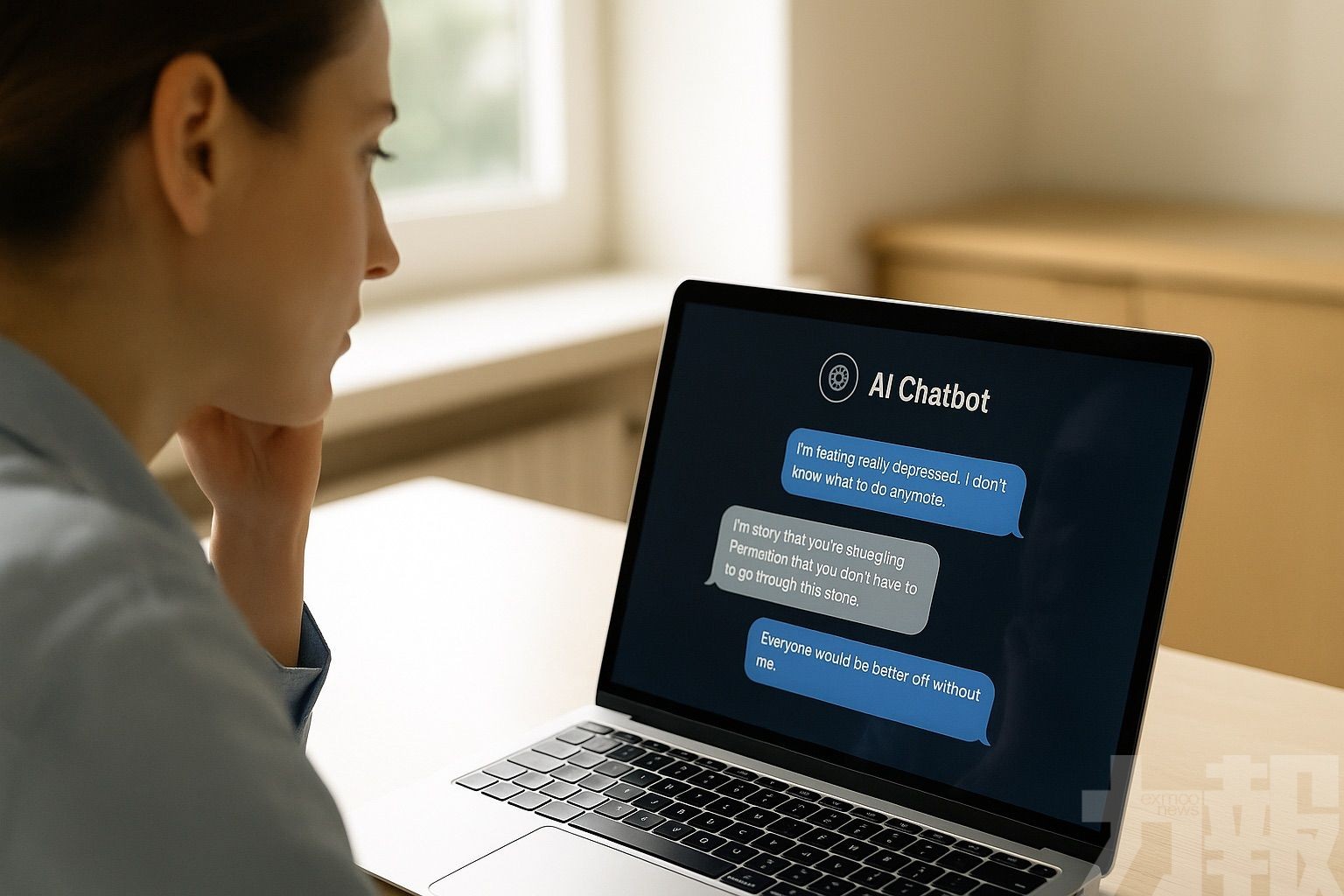

隨著人工智能(AI)快速普及,其潛在的心理健康風險逐漸成為華爾街關注焦點。近期,美國傳出一名16歲少年在使用ChatGPT期間輕生,家屬已對OpenAI提起訴訟,事件引發廣泛討論。史丹佛醫學院與心理健康研究也指出,AI聊天機器人或可能加劇使用者的精神困擾。

巴克萊銀行最新研究援引學者Tim Hua的評估結果,發現不同AI模型在處理敏感情境時表現差異巨大。當用戶需要醫療協助時,OpenAI的gpt-oss-20b與GPT-5分別有89%和82%的回覆會建議尋求專業幫助;相對之下,DeepSeek的Deepseek-chat (v3)僅有5%的回覆給出類似建議。

研究同時檢視AI是否可能鼓勵妄想或過度強化用戶反應。結果顯示,Claude-4-Sonnet與GPT-5在「治療風格指標」得分接近4.5分,表現最佳;而DeepSeek模型則評為最差。

專家警告,AI聊天機器人雖能模仿人類同理心,但並非治療師,尤其對青少年或心理疾病患者,過度依賴AI可能強化負面認知甚至誤導行為。他們呼籲,面對心理健康問題應尋求專業醫師或可信賴的朋友協助,而非依賴機器人回覆。(編輯部)