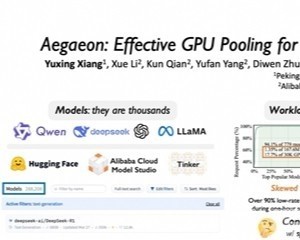

阿里雲在韓國首爾舉行的第31屆操作系統原理研討會(SOSP 2025)上,發表的「Aegaeon」計算池化方案成功入選論文,成為操作系統與AI 基礎設施領域的突破性研究。SOSP被譽為「操作系統界奧斯卡」,錄取率極低,每年僅收錄數十篇頂尖論文。

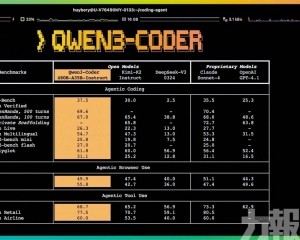

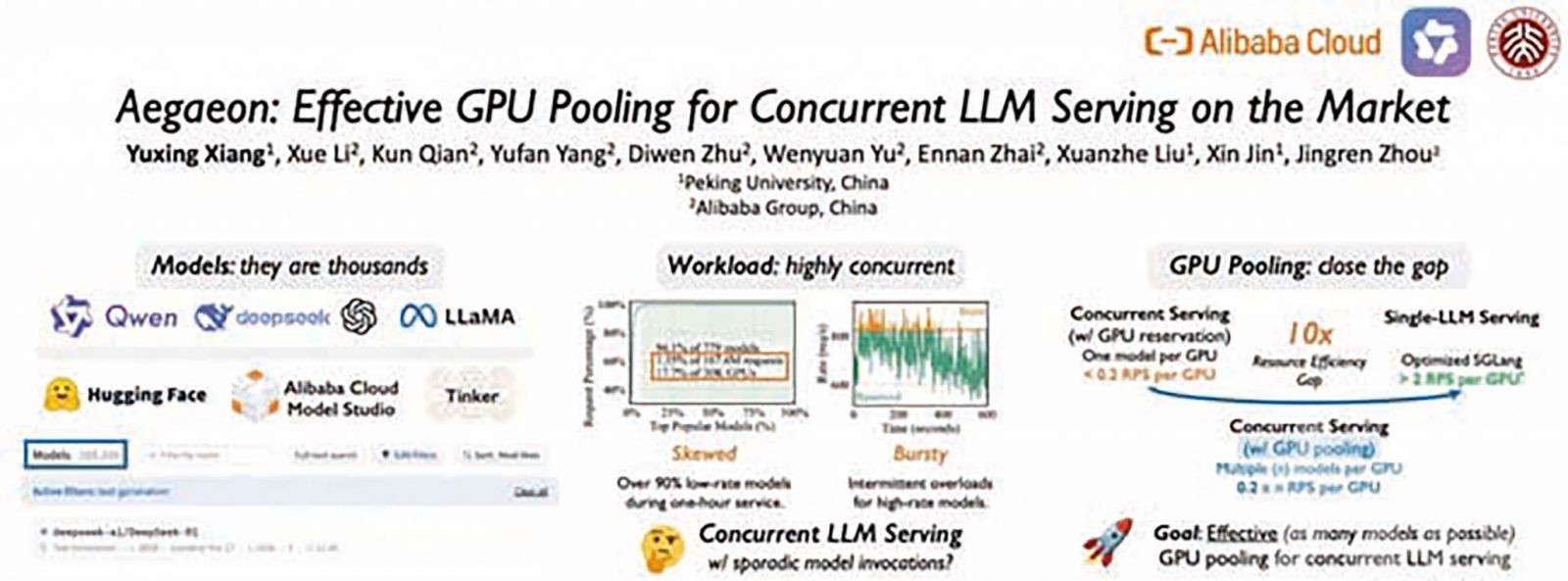

據《南華早報》報道,Aegaeon針對AI模型服務中GPU資源閒置問題提出創新解法。研究顯示,在阿里雲模型市場中,17.7%的GPU算力僅用於1.35%的請求,導致巨額成本浪費。Aegaeon系統透過GPU資源池化技術,讓單張GPU可同時支援多個AI模型運行,打破傳統「一GPU 綁定一模型」的低效架構。

在阿里雲為期三個月的Beta測試中,Aegaeon成功將英偉達H20 GPU需求量從1,192張降至213張,節省達82%,效能仍維持穩定。此研究由阿里云與北京大學合作完成,被認為是首個揭示並解決大型語言模型並發服務高成本問題的實證成果。

該論文作者之一為阿里雲首席技術官、阿里巴巴副總裁周靖人,他同時是IEEE及ACM會士,顯示中國科研團隊在AI基礎架構領域的國際影響力正不斷提升。

阿里雲發表的「Aegaeon」計算池化方案成功入選SOSP2025論文。(網絡圖片)