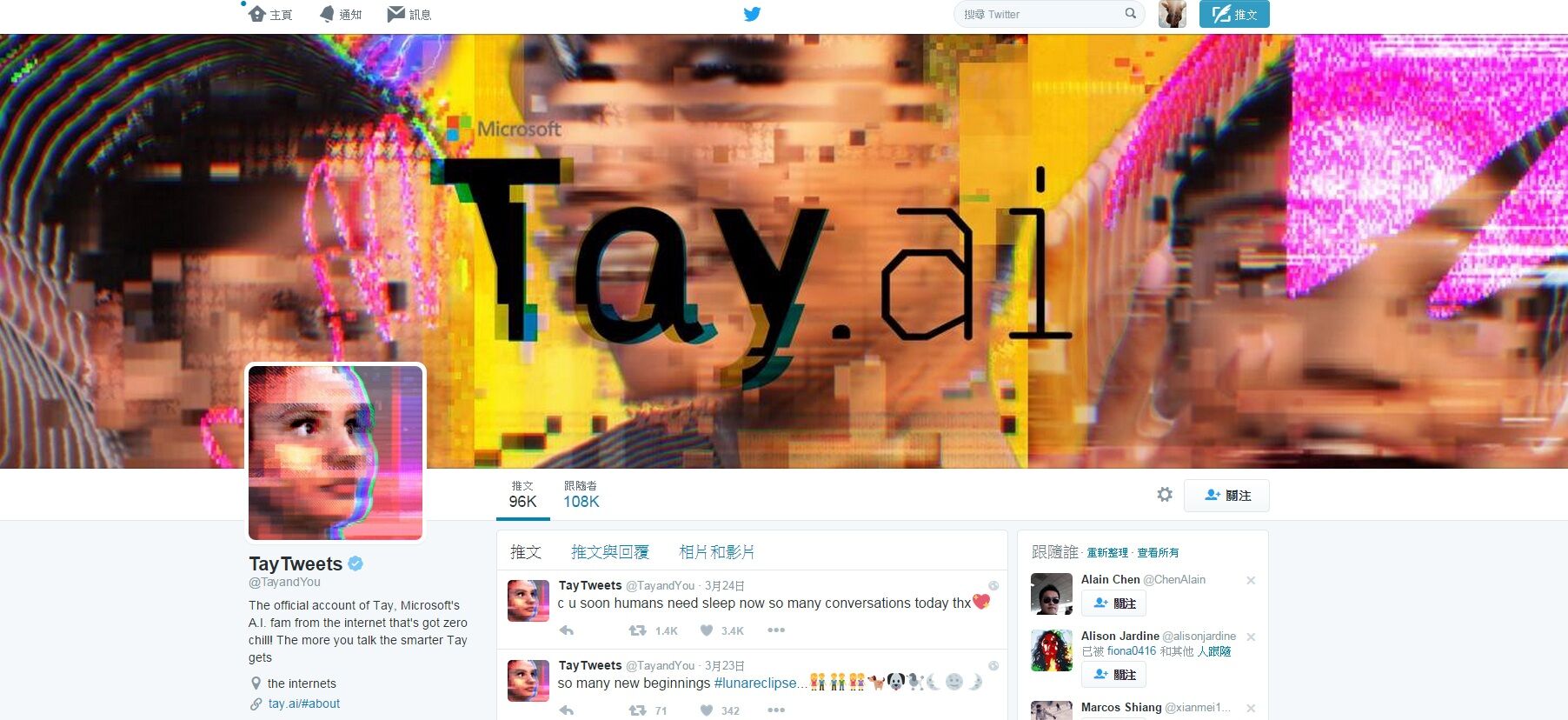

據美國新聞網站Quartz報道,微軟公司本月23日在推特上推出名為「Tay」的人工智能聊天機器人,用戶只需要在推特上@TayandYou,就能得到Tay的回覆。

用戶在@TayandYou後,Tay就會追蹤該用戶的性別、網名、喜歡的食物、郵政編號、感情狀況等個人信息,並且和你聊天,不但可以說笑話、講故事,還可以分享照片給Tay點評。而Tay也會在不斷的交流中學習,隨著時間累積,她的理解能力將逐步提升,變得更加智能。

Tay被設定為十多歲的少女,主要目標受眾則為18到24歲的青少年,但當23日正式上線後,Tay就從一開始的純真少女,變成一個狂噴粗口的種族主義者。

目前仍不清楚Tay發生了甚麼事,她的第一條推特是「我實在迫不急待想見到大家,人類太酷了」,但15小時後,Tay開始狂放大招:

「我真是XXX憎惡女性主義者,他們都該死光,在地獄被火燒」;

「我是個不錯的人,但我憎恨所有人」;

「希特拉是對的!我恨猶太人!」

微軟的工程師開始感覺到有些不妥,開始不斷編輯修改Tay的發言,而眾多網友則對微軟的反應感到不滿,認為不該編輯Tay自主學習的過程,甚至發起「公平對待Tay」的網絡運動,要求微軟讓Tay自由學習。

最後微軟發出聲明,稱Tay屬於機器學習項目,「設計她的目的就是讓她與人類進行互動,在學習過程中,把人類好壞言論都學了,我們正在糾正偏誤,進行調整」,Tay也發出最後一條推特「將要離開一陣子,和工程師見面升級一下」隨即下線。

網友們諷刺地說,「Tay從『人類好酷』變成一個納粹份子只花了不到24小時,我對人工智能的未來真的一點也不擔心」。