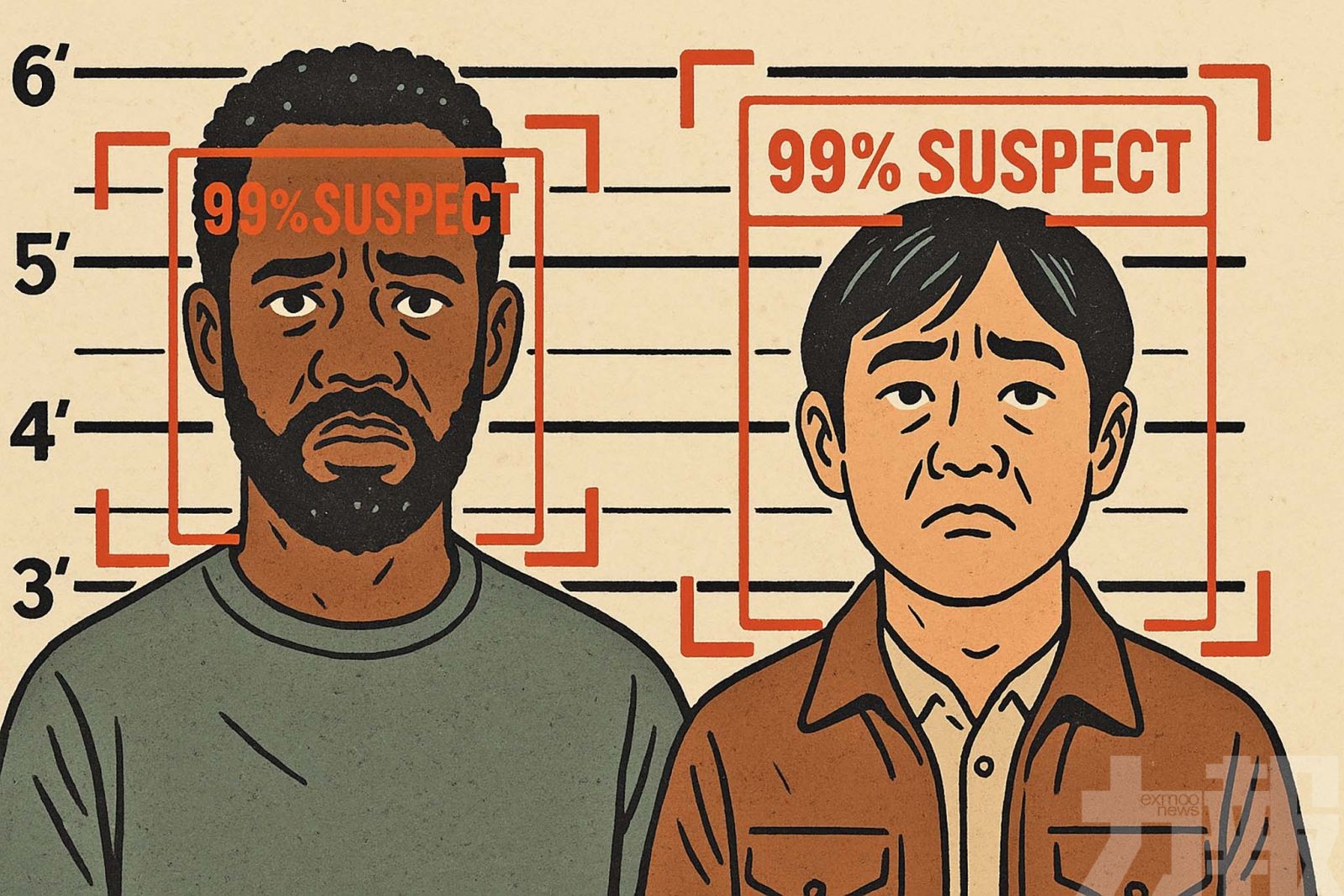

英國政府正計劃在全國層面擴大使用人工智能(AI)人臉識別系統之際,一項最新官方測試結果引發巨大爭議。英國國家物理實驗室(NPL)對警用國家數據庫面部識別系統的獨立評估顯示,在某些系統設定條件下,該技術在族裔識別上存在明顯偏差,黑人與亞裔被錯誤識別為涉案人員的機率顯著高於白人。

英國政府正計劃在擴大使用人工智能人臉識別系統,但有機構指出,該技術在族裔識別上存在明顯偏差。 (AI生成圖片)

相關結果由英國《衛報》於當地時間12月5日披露後,已獲英國內政部證實。警方與治安專員們指出,NPL 公布的數據「揭示令人憂慮的內建偏差」,並在政府積極推動擴大警務實際應用之際,呼籲當局必須保持高度審慎態度,對技術使用設置更嚴格的風險控制機制。

面部識別系統透過掃描現場或錄像畫面中的人臉影像,與通緝名單或涉案人員數據庫進行即時或事後比對,可連接警務、護照及移民紀錄等資料來源,已被視作警方提升執法效率的重要科技工具。然而,這套系統的公平性與可靠性持續遭到人權團體及族群權益組織的質疑。

NPL的測試結果顯示,在誤報風險較高的低設定門檻下,不同族群的誤識率存在巨大差距:白人測試對象的誤報率僅為0.04%,亞裔誤報率則升至4.0%,黑人更高達5.5%。報告同時指出,黑人女性的受影響程度尤為突出,其誤報率高達9.9%,遠高於黑人男性的0.4%。

黑人和亞裔更易被錯誤匹配

就在測試結果發布前數小時,英國警務大臣莎拉.瓊斯(Sarah Jones)仍公開表示,人臉識別技術是「自DNA比對以來最具革命性的執法突破」,並對該系統能協助警方精準鎖定嫌疑人抱持高度期待。該番言論在測試數據曝光後,迅速受到輿論與執法監督團體的質疑。

警方與治安專員協會(APCC)隨後發表聯合聲明直言,測試結果證實系統存在結構性問題:「在某些運作條件下,黑人及亞裔較白人更容易被錯誤匹配。技術說辭或許專業,但現實是該系統在缺乏足夠保障機制的情況下,就已進入實務部署階段。」聲明亦對政府未能及早公開測試結果表示不滿,質疑相關部門明知問題存在卻未與受影響社群或業界利益相關方進行充分溝通。

APCC指出,目前並無證據顯示任何個別案例已直接遭受司法不利後果,但這只能視為「僥倖,而非制度上的安全設計」。他們警告,系統潛藏風險本應在擴大應用前便被嚴肅對待,如今卻是在技術已進入警務實作後才公開揭露。

隨著英國政府推動AI輔助執法政策持續加速,面部識別的應用邊界及族群公平問題正成為社會輿論與立法監督的焦點。人權與公民團體呼籲,當局須暫緩全面推廣計畫,待偏差問題經科學修正及透明監督後再行部署,否則恐削弱公眾對AI警務體系的信任,甚至加劇族群歧視風險。