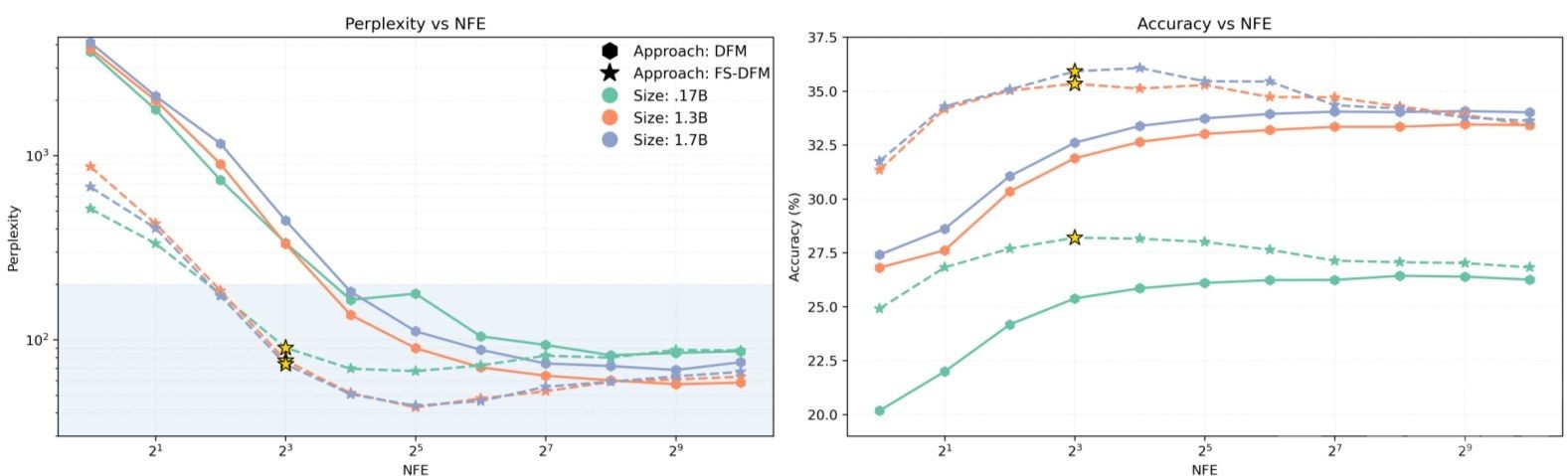

科技媒體9to5Mac報道,蘋果公司與美國俄亥俄州立大學研究團隊近日聯合發表最新AI論文,推出名為 「少步離散流匹配」(Few-Step Discrete Flow-Matching, FS-DFM) 的新型語言模型。該模型在長文本生成方面實現重大突破,僅需8輪快速迭代,即可生成品質媲美傳統擴散模型上千步迭代的文本,生成速度最高可提升 128倍。

與以ChatGPT為代表的自回歸模型逐字生成不同,FS-DFM屬於擴散模型變體,可並行生成多個詞並逐步優化。蘋果團隊為提升效率,採用三項關鍵設計:一是讓模型可靈活適應不同精煉步數;二是引入「教師模型」精準引導每輪更新,避免偏差累積;三是優化整體迭代機制,以更少步驟穩定生成高品質文本。

在性能測試中,FS-DFM對比Dream(70億參數)與LLaDA(80億參數)模型,即便是參數僅 1.7億至17億的FS-DFM版本,也展現出 更低困惑度與更穩定熵值,兼顧準確度與創造力。外界認為,該模型的出現或將讓AI長文生成進入「即時輸出」時代。(編輯部)