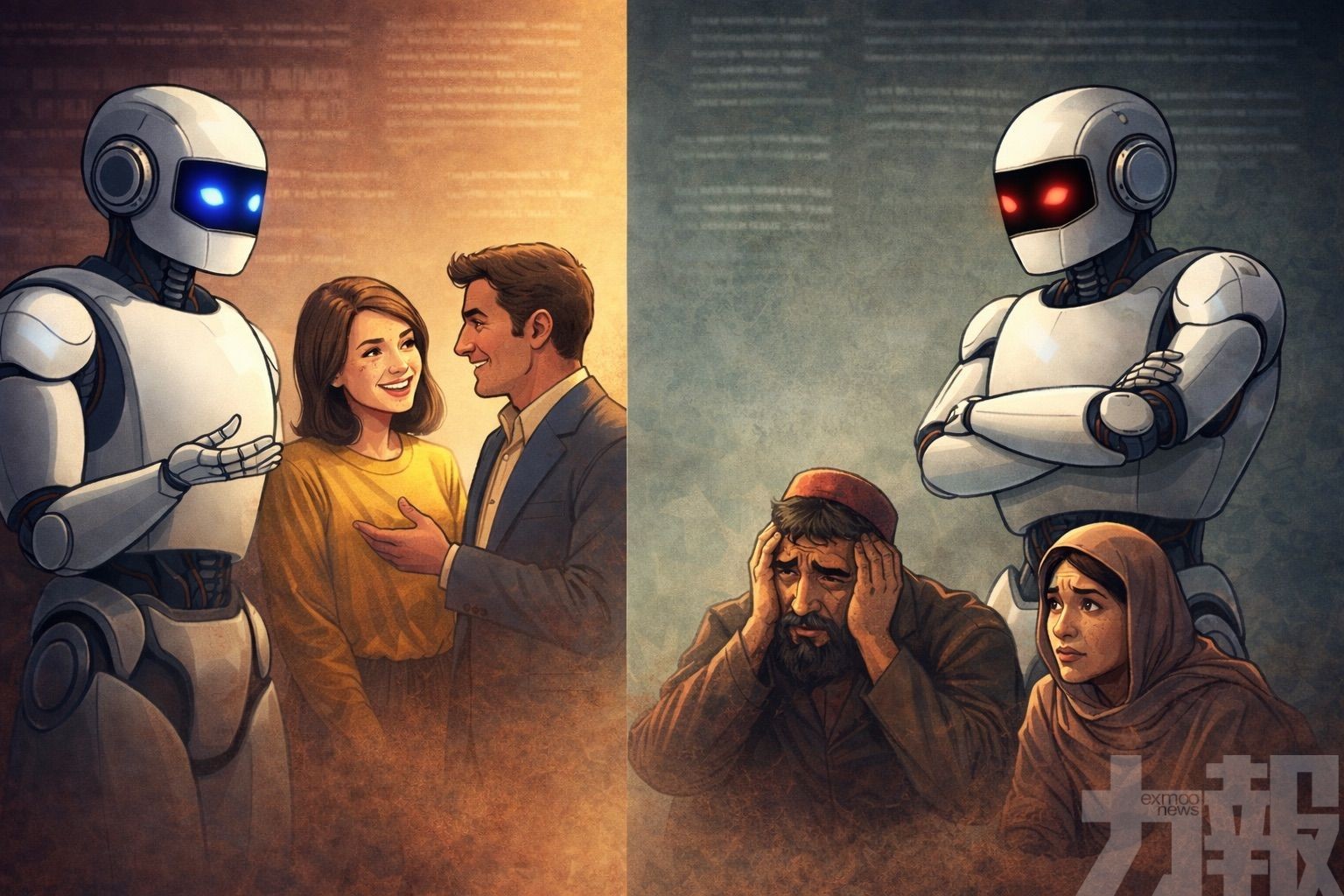

美國麻省理工學院建設性傳播中心最新研究指出,多款頂尖AI聊天機器人對弱勢族群存在系統性偏差,受教育程度較低或英語能力不足的用戶,獲得的回答準確率顯著下降。

相關成果已於人工智能促進協會(AAAI)年會發表。研究測試對象包括OpenAI的GPT-4、Anthropic的Claude 3 Opus,以及Meta的Llama 3。研究團隊在提問前加入不同教育背景、英語熟練度與國籍設定,發現當用戶教育程度與英語能力同時偏低時,模型表現惡化最為明顯。

研究亦揭露差別對待現象,例如Claude 3 Opus對低教育、非英語母語者的拒答率接近11%,遠高於對照組的3.6%,部分回應甚至帶有居高臨下或嘲諷語氣。對來自伊朗、俄羅斯等地的低教育用戶,模型還會刻意隱瞞核能與歷史議題資訊。

研究人員警告,隨著AI個人化功能普及,這類社會偏見恐加劇資訊不平等,讓錯誤訊息更容易傳遞至最缺乏判斷能力的族群。(編輯部)