中國電信公布,其人工智能研究院 中國電信人工智能研究院(TeleAI)研發的生成式視頻壓縮(GVC,Generative Video Compression)技術,已在極低帶寬環境下取得突破性進展。相關研究顯示,原本 高 達1GB的 原 生 視 頻, 透 過GVC技術僅需傳輸約200KB數據,壓縮率低至0.02%,但畫面仍可保持高清、連貫及關鍵細節,意味視頻傳輸的既有技術邏輯正被顛覆。

中國電信新技術將視頻數據的壓縮率到原本的0.02%,仍能保持清晰。 (網絡圖片)

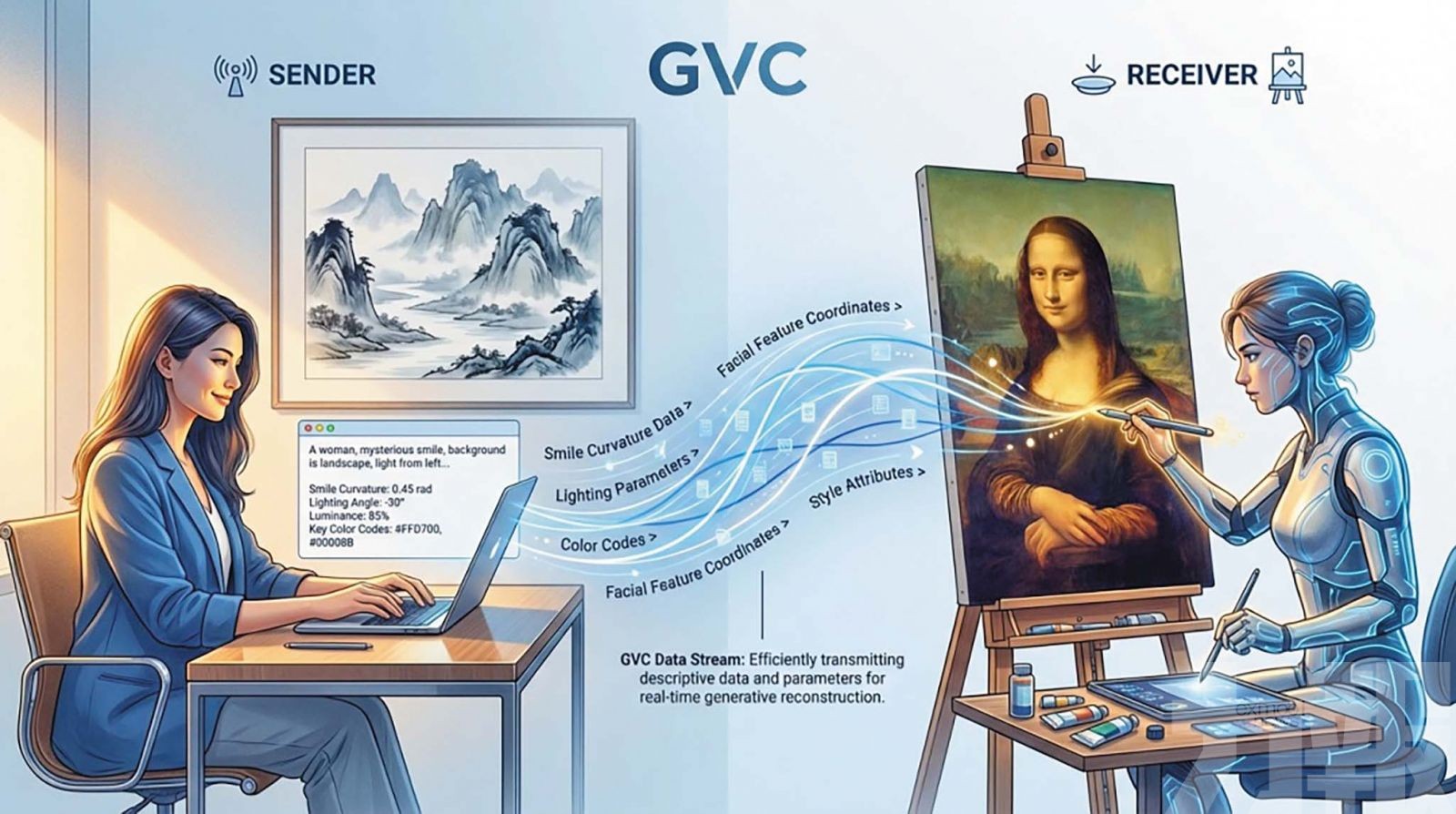

中國電信指出,GVC的核心理念是「 用計算換帶寬 」。與現行主流的HEVC(H.265)或VVC(H.266)視頻編碼標準不同,GVC並非極致壓縮像素資訊,而是改以語義與運動資訊作為主要傳輸內容。簡言之,傳輸端不再發送完整畫面,而是發送高度濃縮的「 生成指令 」,由接收端的生成式模型即時重建視頻內容。

在技術架構上,GVC由神經編碼器與生成式視頻解碼器構成,傳輸的資料為極小型Token,主要涵蓋場景語義(如人物、物體結構)與運動動 態(如 位 移、 節 奏)。TeleAI測 試 顯 示, 這 類Token可 被 壓 縮 至0.005至0.008 bpp(bits perpixel),較一般高清視頻動輒0.1 bpp以上的數據量,直接縮減兩個數量級。

研究結果亦顯示,在極低碼率條件下,GVC 在視覺品質上明顯優於傳統編碼方式。以符合人類主觀感知的LPIPS指標衡量,HEVC在相同帶寬條件下畫面已嚴重失真,而GVC生成畫面仍能維持紋理與結構完整。報告指出,若傳統方法要達到相近視覺效果,所需帶寬至少高出六倍。

機器場景同樣適用

值得注意的是,GVC不僅適用於「給人看」,在「給機器用」的場景同樣具備優勢。TeleAI在DAVIS2017視頻分割任務中驗證,在極限壓縮條件下,GVC重建視頻在關鍵物體識別與輪廓準確度方面,顯著優於HEVC,顯示即使畫面部分細節由AI生成補全,核心語義資訊仍能被準確保留,不影響後續AI分析與判斷。

在落地層面,TeleAI亦針對生成式模型算力需求進行優化。經模型小型化與知識蒸餾後,GVC可在消費級GPU上運行,生成約29幀畫面僅需約1秒,雖仍高於傳統解碼速度,但在直播延遲數秒可接受的場景下,已具備實際應用條件。

中國電信表示,GVC特別適用於極端網絡環境,包括遠洋船舶的窄帶衛星通信、災害應急救援、深空探測,以及自動駕駛車隊的大規模數據回傳。在相關示範場景中,即便僅有微弱信號,GVC仍能生成可判讀的高清視頻,對遠程醫療、設備維修及指揮調度具實質意義。

從理論層面看,GVC 亦被視為「 智傳網(AIFlow)」體系的重要實踐。中國電信集團 CTO、首席科學家、TeleAI院長李學龍曾指出,AI時代的通信本質,正由單純的數據傳輸轉向智能分發與協同。在此框架下,GVC 透過「 計算換帶寬 」的資源置換策略,實現傳輸效率與感知效果的平衡。

業界認為,GVC標誌着視頻通信正由像素壓縮邁向語義生成的新階段。未來網絡中流動的,或不再是龐大的原始數據,而是高度濃縮的智慧與指令,為下一代通信與邊緣智能應用奠定基礎。