人工智能生成3D場景技術迎來新突破。科技媒體《The Decoder》4月16日報道,英偉達(Nvidia)研究團隊推出最新系統Lyra 2.0,僅需一張照片,即可生成跨度約90米的連貫3D環境,並支援即時漫遊,顯著改善現有模型在長距離場景生成中的失真與「遺忘」問題。

目前,AI生成3D場景的一大瓶頸,在於虛擬攝影機進行長距離移動時,畫面容易出現色彩漂移、結構扭曲等問題;當鏡頭返回已探索區域時,模型往往無法準確還原原有場景,而是重新生成,導致前後不一致。這些問題嚴重限制了該技術在機器人訓練與模擬領域的應用。

Lyra 2.0正是針對上述痛點設計。系統核心改進之一,是在生成過程中保存每一幀的3D幾何資訊,形成可回溯的空間記憶。當攝影機再次進入既有區域時,模型可調用歷史數據進行參照,從而避免重建場景,提高整體一致性與穩定性。

此外,為解決逐幀生成過程中誤差累積導致畫面品質惡化的問題,研究團隊採用一種「自我修正」訓練策略。具體而言,模型在訓練時會接觸自身產生的低品質輸出,並學習識別與修正錯誤,而非將缺陷持續傳遞。這使Lyra 2.0在長距離生成任務中,仍能維持較高畫面質量。

效率顯著提升

從測試結果來看,Lyra 2.0在多項關鍵指標上表現突出。官方基準測試顯示,該系統在圖像品質、風格一致性及攝影機控制等方面,全面優於GEN3C、Yume-1.5及CaM等六款同類模型。其中,其Fast版本在維持相近畫質的前提下,生成速度可提升約13倍,顯示出顯著的效率優勢。

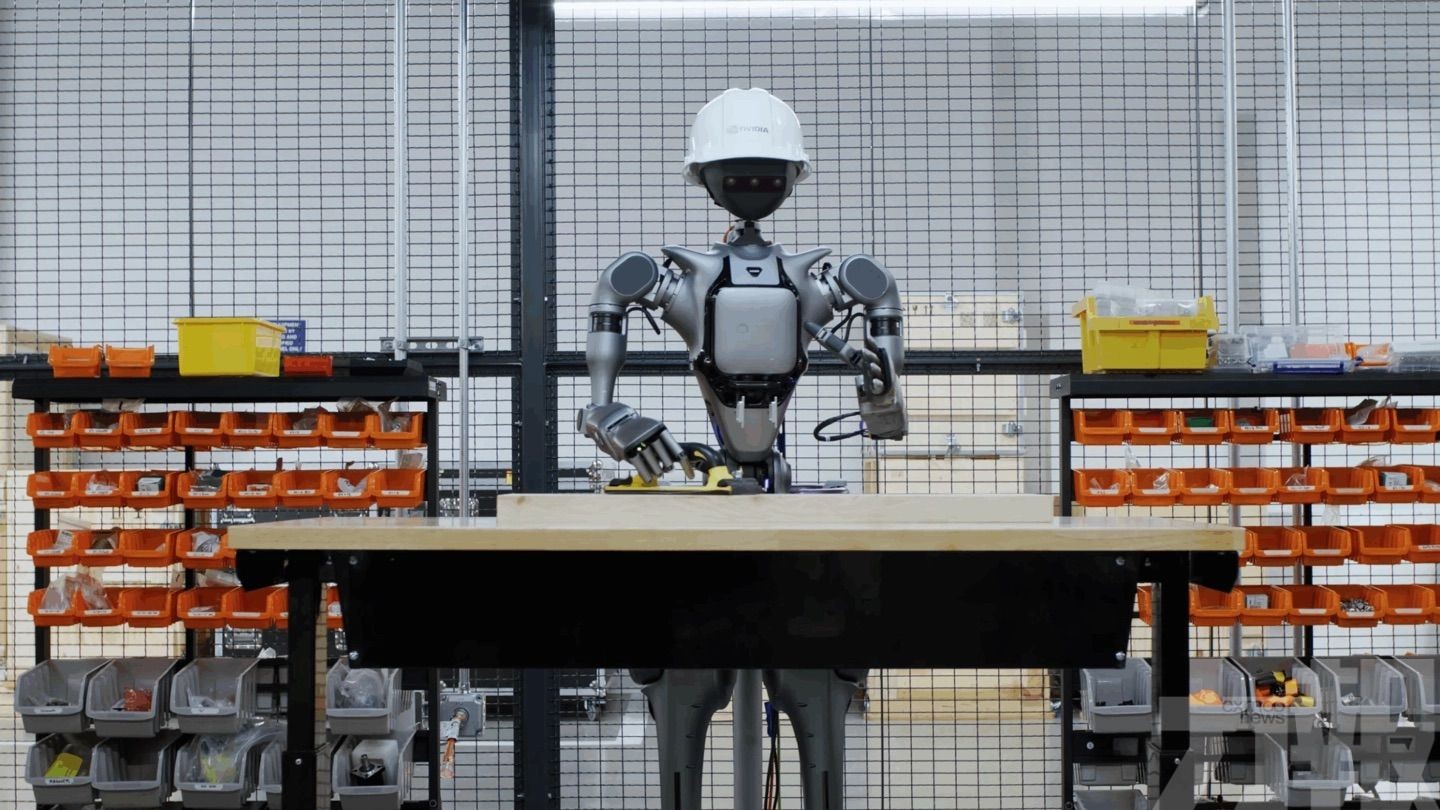

應用層面上,Lyra 2.0生成的3D場景不僅可供使用者進行交互式探索,還可匯出為網格(mesh)格式,進一步導入Nvidia Isaac Sim等物理仿真平台,用於機器人訓練。這意味著,未來機器人開發可在完全虛擬的環境中進行,大幅降低對真實世界3D數據採集的依賴。

業界普遍認為,隨著生成式AI與機器人技術加速融合,高質量、可擴展的虛擬環境將成為關鍵基礎設施。Lyra 2.0的推出,標誌著AI在空間理解與長距離場景生成能力上的重要進展,有望推動自動駕駛、機器人訓練及沉浸式應用等多個領域的發展。

Lyra 2.0不僅提升了3D生成技術的可用性與穩定性,也為AI在虛擬世界建模方面提供了新的技術路徑。隨著相關技術進一步成熟,虛擬與現實之間的邊界,或將加速被重塑。 (編輯部)