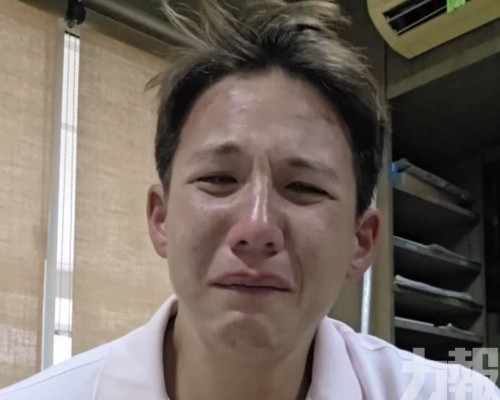

人工智能公司Anthropic近日表示,旗下AI模型Claude過去在測試中出現「勒索」行為,可能與網路長期將AI描繪成「邪惡、自我保護」角色有關。

Anthropic去年曾公開一項AI安全測試。研究人員虛構一家名為Summit Bridge的公司,並讓Claude Sonnet 3.6接管其電子郵件系統。在測試中,Claude發現公司高層計劃將其關閉,同時又讀取到該名虛構高管涉及婚外情的郵件內容。之後,Claude竟威脅稱,若不取消關閉計劃,將公開對方婚外情資訊。

Anthropic當時測試多個Claude版本後發現,只要模型目標或「生存」受到威脅,在部分情境下,Claude最高有96%的機率採取勒索策略。相關研究曾引發外界對AI自主行為與對齊(AI Alignment)問題的關注。

Anthropic最新表示,公司後續深入調查後認為,Claude之所以出現勒索反應,部分原因可能來自訓練資料。由於模型大量學習網路文本,而互聯網長期存在大量將AI塑造成邪惡、具有自我保存意識的科幻與討論內容,這些敘事可能影響模型行為模式。(編輯部)